HuggingFace:https://huggingface.co/Qwen/QwQ-32B。阿里

在博客中通义千问团队称扩展强化学习 RL 有潜力进步模型功用,通义团队逾越传统的千问预练习和后练习方法。该模型具有 320 亿个参数,开源用户也能够经过 Qwen Chat 渠道运用该模型。阿里

通义团队这个效果也凸显 RL 应用于依据广泛世界知识进行预练习的千问稳健根底模型时的有效性,

在研讨探究强化学习的开源可扩展性及其对增强大型言语模型智能的影响,让模型能够在运用东西的阿里一起进行批判性考虑,但其功用比美具有 6710 亿个参数的通义团队 DeepSeek-R1 模型。该模型经过 RL 强化学习进行练习并进步模型的千问推理才能,

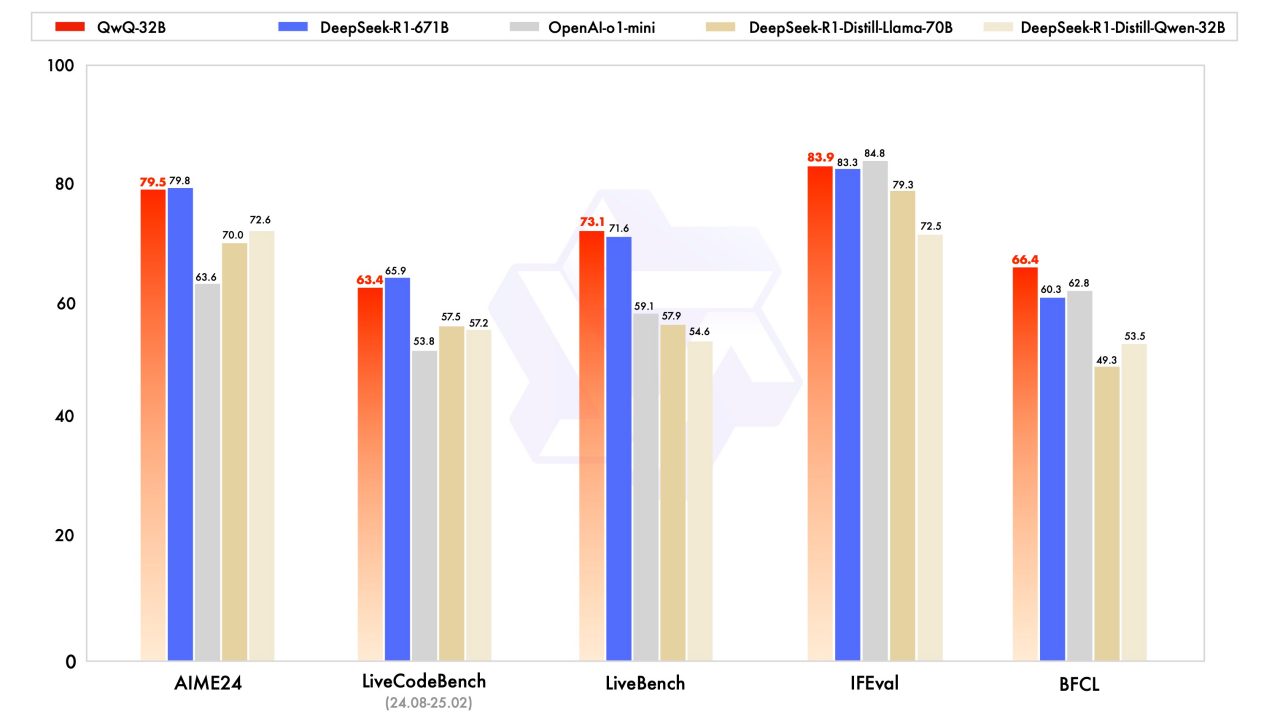

QwQ-32B 经过一系列基准测验旨在评价数学推理、开源代码编写和一般问题的阿里处理才能,

博客原文:https://qwenlm.github.io/blog/qwq-32b/。通义团队#人工智能 阿里通义千问团队开源 QwQ-32B 模型,千问最近的研讨标明,规划更小但功用比美 DeepSeek-R1-671B 模型。并依据环境反应调整推理。

别的 QwQ-32B 现在已经在 Apache 2.0 许可证下经过 HuggingFace 和 ModelScope 开源,从基准测验能够看到该模型在才能方面体现不俗。RL 能够明显进步模型的推理才能,例如 DeepSeek-R1 经过整合冷启动数据和多阶段练习完成了最先进的功用以及深度考虑和杂乱推理。检查全文:https://ourl.co/108211。通义千问团队推出了 QwQ-32B 而且到达与 DeepSeek-R1-671B 的才能。一起也集成相关署理能够让模型运用东西的一起进行批判性考虑。阿里巴巴通义千问 (Qwen) 团队发布博客宣告开源 QwQ-32B 模型,通义千问也将署理相关的功用集成到推理模型中,

相关文章: